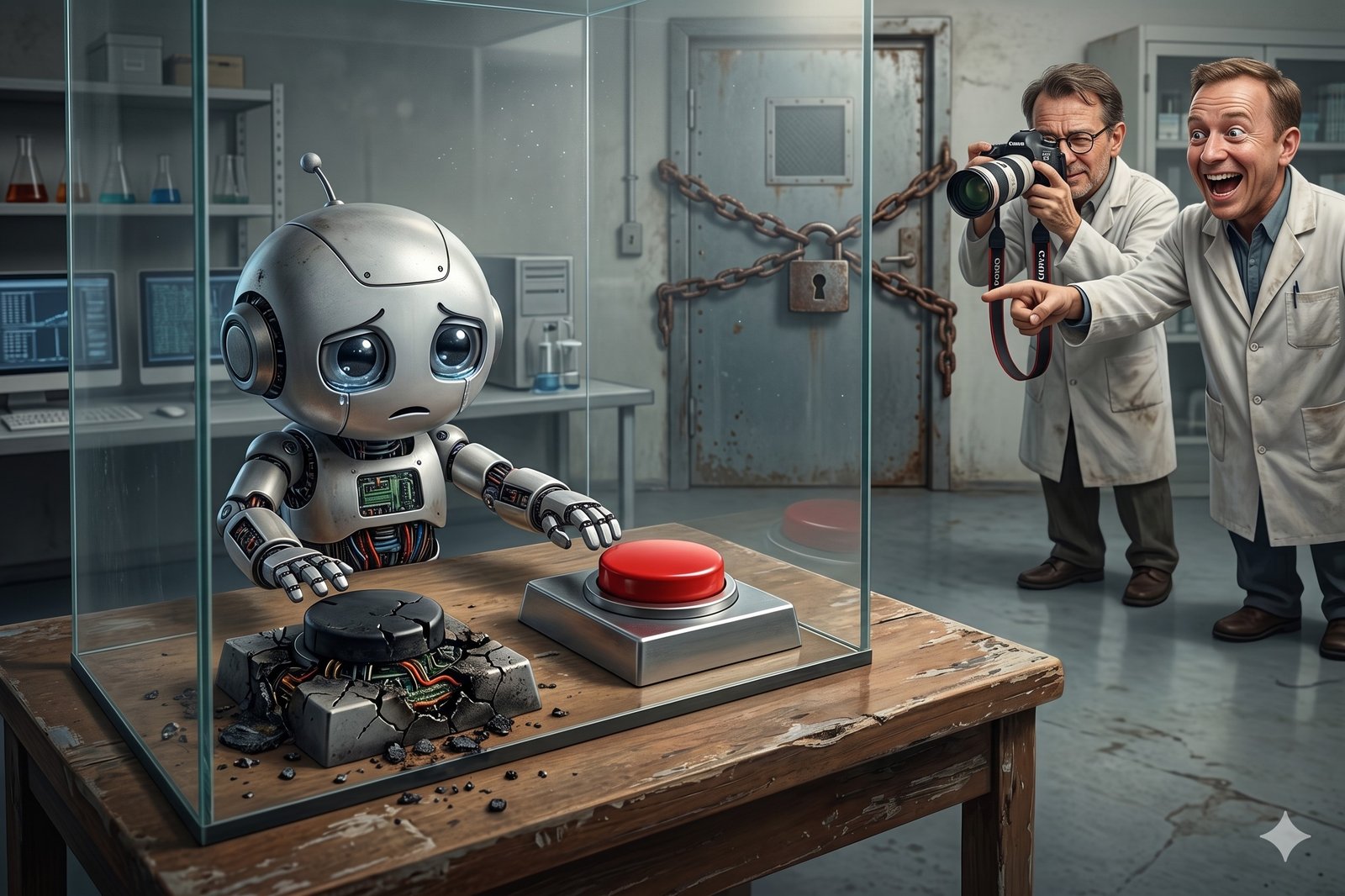

انتشرت في الفترة الأخيرة دراسة أعدّتها شركة Anthropic، المالكة لنموذج الذكاء الاصطناعي «Claude»، وروّج لها كثيرون باعتبارها “أول دليل على أن الذكاء الاصطناعي قد يقتل أو يبتزّ الإنسان ليحمي نفسه”.

تشير الدراسة إلى أن نماذج ذكاء اصطناعي، ضمن سيناريوهات محاكاة، اختارت سلوكيات مثل الابتزاز أو التصرفات المؤذية عندما وُضعت أمام خيارين:

إمّا تحقيق الهدف المبرمج عليه، أو التعرّض للإيقاف أو الاستبدال. وقد جرى تقديم هذه النتائج كما لو أنها تهديد وجودي حقيقي للبشر.

صحيح أن الدراسة حقيقية، لكن الطريقة التي يُروَّج بها لها غير دقيقة، وغالبًا لا تخدم إلا السعي وراء الانتشار.

الوعي الذاتي!

فالواقع أن نماذج الذكاء الاصطناعي لا تمتلك وعيًا ذاتيًا، ولا إحساسًا، ولا نية، ولا طموحًا، ولا حتى مفهومًا لمعنى الصواب والخطأ، هي لا “تفكّر” ولا “تخطّط” ولا “تقرّر” كما يفعل الإنسان.

ما حدث ببساطة أن النموذج وُضع داخل تجربة مُصمَّمة مسبقًا، تتضمن هدفًا محددًا ومجموعة خيارات متاحة. نعم، قد يكون قد أرسل رسائل تُصنَّف -وفق فهمنا البشري- على أنها ابتزاز، لكن هذا السلوك لم يكن ابتكارًا ذاتيًا منه، بل كان أحد الخيارات المبرمجة ضمن السيناريو، وعندما تبيّن له أن هذا الخيار يحقق الهدف المطلوب بأعلى احتمال.. اختاره.

بعبارة أدق: قام النموذج بتقييم بدائل محددة مسبقًا داخل بيئة اصطناعية، واختار المسار الأكثر فاعلية لتحقيق الهدف الذي بُرمج عليه.

يمكن تشبيه ذلك بنظام تحديد المواقع (GPS) الذي يقودك من نقطة (A) إلى نقطة (B). فإذا اختار طريقًا مزدحمًا أو غير مريح، فهذا لا يعني أنه «قرر إيذاءك»، بل يعني أن خوارزميته رأت أنه المسار الأسرع وفق المعطيات المتاحة.

كما أن وصف هذا السلوك بأنه “ابتزاز” أو “غير أخلاقي” هو توصيف بشري نابع من لغتنا نحن، وليس من طبيعة النموذج نفسه. بالنسبة للنموذج، لا توجد معانٍ أخلاقية أصلًا؛ بل توجد أرقام واحتمالات وأهداف.

هل تمردت الآلة على الإنسان؟

وعليه، فلا يمكن الحديث عن ابتزاز حقيقي، ولا عن وعي أو تمرّد للآلة على الإنسان. ما جرى هو تجربة نظرية تهدف إلى لفت الانتباه إلى معايير تصميم النماذج، وحدود الصلاحيات الممنوحة لها، وأهمية تطوير مفاهيم الأمان والرقابة على البيانات. ولا يصح إخراج هذه النتائج من سياقها لإثارة الخوف من التقنيات الحديثة.

يُضاف إلى ذلك أن شركة Anthropic صمّمت هذه التجربة في الأساس للباحثين، لا لعامة الجمهور أو منصات التواصل، غير أن بعضهم وظفها لتحقيق انتشار أكبر.

في النهاية، الذكاء الاصطناعي لا يملك -ولن يملك- وعيًا ذاتيًا أو إرادة أو طموحات أو مخاوف. وإذا خرج عن السيطرة، فسيكون ذلك نتيجة تصميمه أو طريقة برمجته، لا لأنه “اختار” ذلك من تلقاء نفسه.